AI-Entwickler

Role details

Job location

Tech stack

Job description

AI-Entwickler (m/w/d) Vollzeit · deutschlandweit · remote Deine Rolle bei nolas Als AI Developer bei nolas entwickelst du intelligente Funktionen für unser Betriebssystem zur Steuerung organisatorischer Prozesse. Du bringst Erfahrung aus realen Organisations- und Softwarekontexten mit und verstehst, wie Nutzer, Workflows und Dokumentenprozesse tatsächlich funktionieren. Auf dieser Grundlage entwickelst du KI-gestützte Lösungen, die Entscheidungen unterstützen, Daten aus Dokumenten extrahieren und Prozesse effizient automatisieren. Konkret bedeutet das:

- Agentische Systeme: Du entwickelst KI-Agenten und intelligente Anwendungen (z. B. LLM-basierte und agentische Systeme) - von der Idee bis zum produktiven Einsatz.

- Multimodale Pipelines: Du entwickelst multimodale Pipelines für Dokumentenklassifikation und Datenextraktion. Dabei deckst du den gesamten Prozess ab - von der Klassifikation bis zur strukturierten Datenextraktion mit räumlich sensiblen Modellen.

- Souveräne KI: Du implementierst und optimierst selbst gehostete LLMs (vor allem Mistral und andere Open-Weights-Modelle), um Datensouveränität und hohe Performance sicherzustellen.

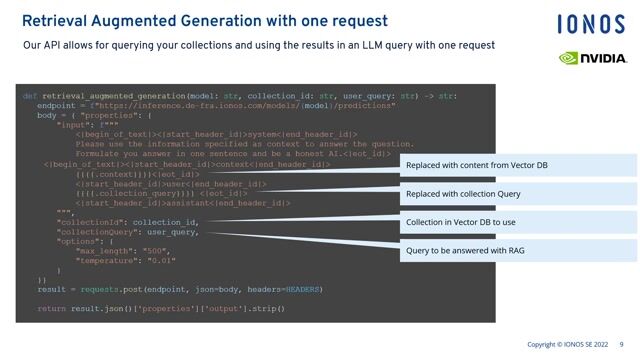

- Advanced RAG: Du entwickelst RAG-Architekturen (Retrieval-Augmented Generation) für effiziente Datenabfragen und kontextbasiertes Reasoning über mehrere Mandanten hinweg.

- Inference-Architektur: Du wählst die passenden Frameworks und Komponenten aus, um Performance und Skalierbarkeit unserer gesamten Inference-Architektur sicherzustellen.

- MLOps & Zuverlässigkeit: Du arbeitest nicht nach dem Prinzip "deploy and forget". Du entwickelst Infrastruktur zur Überwachung von Agent-Reasoning, erkennst Veränderungen in Dokumentenlayouts und stellst eine Extraktionsgenauigkeit von 99,9 % sicher., * Programmiersprachen: Python (Primär), Java, TypeScript

- Inference & Serving: vLLM, NVIDIA Triton Inference Server

- Modelle: Mistral (LLM), LayoutLM (VDU), DocTR (OCR), LSTM, Transformers, Vision Transformer (ViT)

- Frameworks: Scikit-learn, Pandas, XGBoost, LangChain, LlamaIndex

- Infrastruktur: Self-hosted AI Pipelines, REST APIs, Vector Stores

- Weitere Technologien: Kafka, Object Storage, WebSockets

Was dich bei nolas erwartet

- KI-Lösungen entwickeln, die reale Probleme lösen und produktiv eingesetzt werden

- Technologien, Modelle und Anwendungen von der Idee bis zum Produkt mitgestalten

- Schnelle Entscheidungen, hohe Geschwindigkeit und klare Verantwortlichkeiten

- Ein ambitioniertes Team mit Vision, Substanz und starkem Umsetzungswillen

Requirements

Technologie & Entwicklung

- GenAI & Document Intelligence: Fundierte Kenntnisse und praktische Erfahrung in der Softwareentwicklung sowie Erfahrung mit generativer KI, NLP und datengetriebenen Projekten im Kontext realer Organisations- und Dokumentenprozesse. Du kennst dich mit Visual Document Understanding (VDU) aus, z. B. mit LayoutLM sowie OCR- und Vision-Bibliotheken wie DocTR.

- Data Science & Analyse: Du kannst große Datenmengen analysieren, Zusammenhänge erkennen und prädiktive Modelle entwickeln, um komplexe organisatorische Probleme zu lösen.

- Polyglot-Entwickler: Sehr gute Kenntnisse in Python sind Voraussetzung. Erfahrung mit weiteren Sprachen wie Java, TypeScript oder Go ist von Vorteil.

- Systemarchitektur: Erfahrung im Aufbau und Betrieb von REST APIs, Vektor-Datenbanken und relationalen Datenbanken sowie in der Integration und Optimierung von Modellen in skalierbaren Anwendungen.

- Projekte: Du hast bereits an realen Projekten gearbeitet und Ergebnisse geliefert.

Daten & KI-Modelle

- Model Serving & Optimierung: Erfahrung im Deployment und Skalieren von Modellen mit vLLM und Triton Inference Server.

- Datenanalyse: Du kannst große Datenmengen analysieren, strukturieren und für Training und Entwicklung aufbereiten.

- Extraktionstechniken: Erfahrung mit hybriden Extraktionsmethoden, bei denen DocTR für Text- und Layout-Erkennung und LLMs (z. B. Mistral) für semantisches Verständnis kombiniert werden.

- Skalierbare KI-Systeme: Erfahrung mit der Bereitstellung von Modellen in Cloud- oder Produktionsumgebungen, mit Fokus auf Multi-Tenant-Sicherheit und Performance.

- Datenlebenszyklus: Du kannst große, unstrukturierte Datensätze analysieren, bereinigen und strukturieren - für Training, Fine-Tuning und Evaluation.