Werkstudent AI & Data Platform Engineering

EOS Group

Krailling, Germany

2 days ago

Role details

Contract type

Internship / Graduate position Employment type

Part-time (≤ 32 hours) Working hours

Regular working hours Languages

German Experience level

Junior Compensation

€ 35KJob location

Krailling, Germany

Tech stack

Artificial Intelligence

Amazon Web Services (AWS)

Azure

Cloud Computing

Databases

Data Architecture

Data Infrastructure

ETL

Google Cloud Platform

Large Language Models

Databricks

Requirements

- Immatrikulierter Student (m/w/d) in Informatik, Data Science, Software-Engineering oder vergleichbar

- Erste praktische Erfahrung mit Python, Datenverarbeitung, APIs sowie gute SQL-Kenntnisse

- Grundverständnis von Datenpipelines, ETL-Prozessen, REST-Schnittstellen und Datenarchitektur

- Interesse an AI-/LLM-Anwendungen sowie idealerweise erste Erfahrung mit LLM-Frameworks und Vector Databases

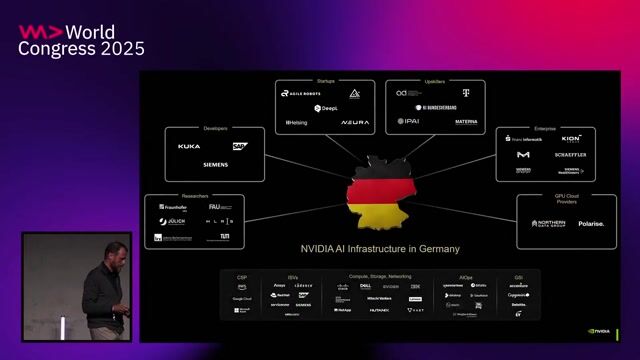

- Idealerweise Kenntnisse in Data-Platform-Technologien (z. B. Databricks), Cloud (AWS, Azure, GCP) und Datenmodellierung

Benefits & conditions

- Ein attraktives Gehalt von 17,00€/Stunde

- Nutzung von Corporate Benefits

- Viele Gestaltungsspielräume, um Zukunftsideen zu entwickeln und bereits als Student:in Verantwortung zu übernehmen

- Subventioniertes Betriebsrestaurant, Frisches Obst, Kaffee & Wasser inkl.

- Praxisbezogene Einarbeitung und gezielte Weiterbildungsmöglichkeiten

- Moderne Arbeitsumgebung

About the company

Wir, EOS - Weltmarktführer für industriellen 3D-Druck, suchen dich als Unterstützung für unser Customer Success Management Team in Krailling.

TECHNOLOGIE ist, was uns verbindet. SINNHAFT ist unser tägliches Handeln. UNABHÄNGIG ist, was wir bleiben. Wir glauben, dass wir dazu beitragen können, eine bessere Welt für alle zu schaffen - dafür steht EOS.

Deine Mission

* Datenpipelines entwickeln und optimieren: Du baust und verbesserst skalierbare Datenpipelines für AI-Anwendungen und stellst eine zuverlässige Datenverarbeitung sicher.

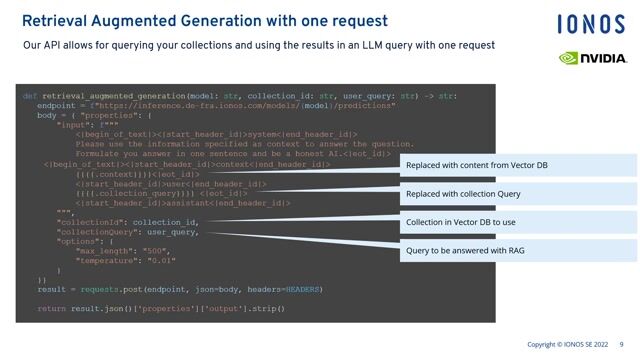

* Daten für LLMs nutzbar machen: Du bereitest Daten für moderne AI-Use Cases auf, z. B. durch Chunking, Embeddings und Indexing.

* Vector Databases betreiben: Du unterstützt beim Betrieb sowie bei der Performance-Optimierung von Vektordatenbanken.

* Systeme integrieren und Workflows orchestrieren: Du verbindest verschiedene Datenquellen, entwickelst APIs und unterstützt bei der Orchestrierung von Daten- und AI-Workflows.

* AI-Architekturen mitgestalten: Du arbeitest an RAG-Systemen und AI-Agent-Architekturen mit und bringst dich bei Themen wie Datenqualität, Performance und grundlegender Governance ein.