ML/AI Platform Engineer

Role details

Job location

Tech stack

Job description

Als Teil des Teams bist du für Auswahl und den Betrieb von Lösungen im Bereich KI und Machine Learning als Basis für Anwendungen und Funktionen, die von Data Scientists und Produktentwicklungsteams in verschiedenen Fachbereichen oder auch von Dienstleistern entwickelt und genutzt werden, verantwortlich.

Unser Tech Stack basiert auf der Google Cloud Platform und Kubernetes. Du wirst ML(Ops)-Tools auswählen (wie MLflow,Vertex AI,Vector Databases für RAG-Anwendungen).

Du arbeitest eng mit den Kolleg:innen aus DevOps, Data Platform, Data Science, (Produkt-)Entwicklung in Redaktion und Verlag zusammen. Im direkten Austausch mit unseren Stakeholdern stellst du sicher, dass unsere Plattform maximalen Mehrwert liefert.

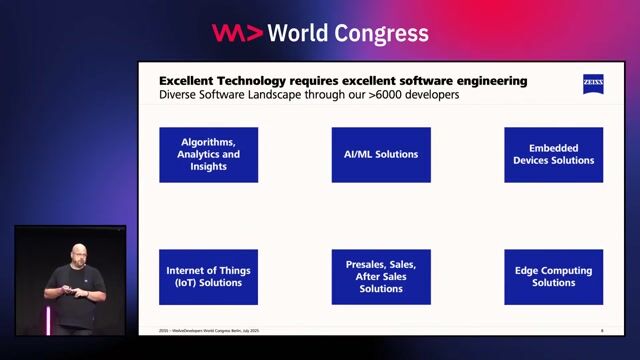

Deine Rolle hat drei Komponenten:

-

ML/AI-Plattform auswählen, aufbauen und betreiben: Du entwickelst und betreibst eine MLOps-Plattform und definierst Standards für Entwicklung, Deployment und Betrieb von KI-Modellen. Dein Fokus liegt auf einer sicheren und skalierbaren Architektur, deren Stabilität du u.a. durch Monitoring und Observability gewährleistest.

-

Integration ermöglichen: Du schaffst oder evaluierst Tools und Services, die es Data Scientisten und Produktentwicklern ermöglicht, unsere ML- und Generative-KI-Use Cases nahtlos zu integrieren. Du bist der technische Enabler, der komplexe ML und LL-Modelle, die die Data Science- und Product-Teams bauen, produktionsreif macht. Dies umfasst die Integration von ML-Modellen in produktive Anwendungen und bestehende IT-Landschaften sowie die Implementierung von Model Observability und Monitoring (z.B. Erkennung von Model Drift, automatisches Retraining).

-

Datenanbindung und Kollaboration: Du stellst ML/AI-spezifische Datenbanken bereit und entwickelst in enger Abstimmung mit angrenzenden Abteilungen die Anbindungen an bestehende Datenquellen. Du berätst und arbeitest eng mit Data Science, DevOps, Software Engineering, Produkt und den Fachbereichen zusammen.

Du musst aber kein/e ausgewiesene/r Expert:in in all diesen Bereichen sein. Sofern du in einigen Punkten Erfahrung gesammelt hast und Spaß an der ganzheitlichen Betrachtung des MLOps-Lebenszyklus hast, lässt sich alles andere erlernen.

Requirements

-

Technischer Hintergrund: Studium im Bereich (Wirtschafts-)Informatik, Ingenieurwesen, Mathematik, Data Science oder vergleichbare Fachrichtung - oder eine entsprechende technische Ausbildung.

-

Praxiserfahrung in der Softwareentwicklung mit Python in Positionen wie ML Engineer, DevOps Engineer, Data Scientist oder Software Engineer mit ML-Anteil (d.h. konkret Nutzung von Bibliotheken wie Huggingface, scikit-learn oder PyTorch/TensorFlow.)

-

Cloud-Native: Du hast fundierte praktische Erfahrung mit Cloud-Infrastrukturen (vorzugsweise GCP) sowie tiefgreifende Kenntnisse in zentralen Themen wie Cloud IAM, Workload Identity, Cloud Networking, Cloud Storage und Vertex AI.

-

Plattform-Mindset: Du denkst in Self-Service-Lösungen und abstrahierst technische Komplexität, sodass sich Data Scientists voll auf die Entwicklung und Optimierung ihrer Modelle konzentrieren können.

-

IaC & GitOps: Du hast das Infrastructure-as-Code-Prinzip (Terraform, alternativ OpenTofu oder Pulumi) sowie das GitOps-Prinzip (z. B. mit Flux oder Argo CD) verinnerlicht und setzt beide konsequent in der Praxis ein.

-

Kubernetes & Container: Du verfügst über tiefgehende Kenntnisse in der Container-Entwicklung und im Deployment (inkl. Helm-Chart-Entwicklung) sowie im effizienten Management von CPU- und GPU-Workloads, Skalierung und Resource Management.

-

Data-Orchestrierung: Du hast Erfahrung im Aufbau von ETL- und Datenpipelines sowie mit Workflow-Orchestrierung (z. B. Airflow, Argo Workflows oder Kubeflow).

Nice to have:

-

MLOps Tools & good Practices: Praktische Erfahrung mit Model Training, Deployment und idealerweise mit LLMs. (Mlflow, DVC, Weights & Biases, Vektor-Datenbanken,…)

-

Praktische Erfahrung in der Arbeit mit Large Language Models (LLMs), auch mit OpenSource-Modellen, und Architekturen wie Retrieval-Augmented Generation (RAG).

Dein persönliches Profil:

-

Du gehst strukturiert an Fragestellungen heran: Deine Stärken liegen in einem ausgeprägten Verständnis für Daten und Prozesse sowie einer analytischen Herangehensweise.

-

Du hast Freude daran, Projekte zu begleiten und voranzutreiben und für einen Teil unserer Stakeholder verantwortlich zu sein, da wir diese Verantwortlichkeiten teamintern verteilen werden.

-

Du bist neugierig, initiativ und lösungsorientiert. Du hast ein starkes Interesse daran, auch die Fachbereiche zu verstehen, um durch nachhaltige Entscheidungen die Daten- und KAI-Llandschaft des Zeitverlags für die kommenden Jahre aktiv mitzugestalten.

Unser Team.

Das Team ML/AI Platform ist Teil von ZEIT Data mit ca. 20 Data Practitioners (Technical Web Analysts, Data Engineers, Analytics Engineers, Data Analysts und Data Scientists), darum gibt es zudem einer Community von Data Scientists in anderen Abteilungen des Hauses. Im Team sprechen und schreiben wir Deutsch, den Code schreiben wir auf Englisch.

Benefits & conditions

Die ZEIT Verlagsgruppe ist ein Arbeitgeber, der für Chancengleichheit und einen respektvollen Umgang steht. Wir setzen uns ein für faire Beschäftigungsmöglichkeiten unabhängig von ethnischer oder sozialer Herkunft, Geschlecht, Religion, Weltanschauung, Alter, sexueller Identität oder Behinderung. Wir möchten ausdrücklich Menschen mit vielfältigen Hintergründen dazu ermutigen, sich zu bewerben, und freuen uns besonders über Bewerbungen von Personen, die zur Diversität unseres Unternehmens beitragen möchten. Unser Arbeitsumfeld ist geprägt von Wertschätzung und Anerkennung - dafür setzen wir uns jeden Tag ein. If you require alternative methods of application or screening, you must approach the employer directly to request this as Indeed is not responsible for the employer's application process.