Data Engineer

Bimona

2 days ago

Role details

Contract type

Permanent contract Employment type

Part-time (≤ 32 hours) Working hours

Regular working hours Languages

Dutch, EnglishJob location

Remote

Tech stack

JavaScript

ActiveMQ

Amazon Web Services (AWS)

Relational Databases

DevOps

Python

PostgreSQL

Message Broker

Modbus

MongoDB

Openshift

Oracle Applications

Software Architecture

Redis

OPC Unified Architecture

DataOps

Data Processing

Caching

Gitlab

GIT

Information Technology

Cassandra

Kafka

Apache Nifi

Docker

Jenkins

Job description

- Stakeholders consulteren en gebruikersvereisten en functionele specificaties mee verfijnen.

- Vereisten helpen vertalen naar een softwarearchitectuur, in samenwerking met een senior developer of architect.

- Schaalbare, performante, onderhoudbare en betrouwbare datapipelines ontwikkelen voor realtime extractie, verrijking en publicatie van data in de UNS.

- Pipelineprestaties opvolgen en optimaliseren (latency, throughput, failures).

- Custom softwarecomponenten ontwikkelen om data vrij te maken uit eerder afgesloten systemen.

- Junior developers begeleiden en technische ondersteuning bieden.

- Code reviews uitvoeren en naleving van best practices en codeerstandaarden bewaken.

- Technische problemen en uitdagingen identificeren en oplossen.

- Op de hoogte blijven van de nieuwste industrie-trends en technologieën om de in-house oplossingen state-of-the-art te houden.

Wij regelen een gesprek met jouw nieuwe potentiële werkgever en fungeren tegelijkertijd als tussenpersoon. We krijgen een beeld van beide kanten over hoe het proces ervaren wordt en maken deze feedback over aan alle betrokken partijen.

Requirements

- Masterdiploma in informatica, ingenieurswetenschappen, automatisering of een verwant vakgebied.

- Diepgaande kennis van een Unified Namespace (UNS) en de onderliggende concepten.

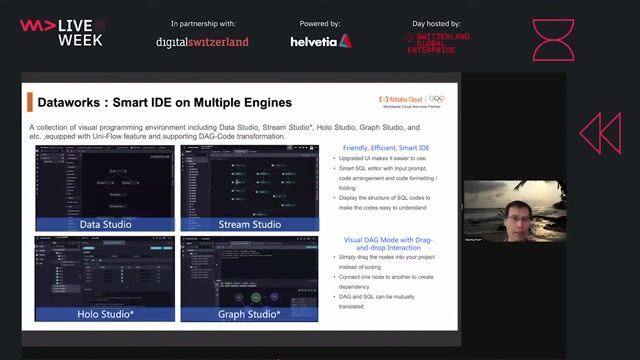

- Ervaring met DataOps-platformen voor data-extractie, -verrijking en -publicatie (bv. HighByte, Apache NiFi, Litmus, HiveMQ, …).

- Kennis van message broker-technologie (Kafka, ActiveMQ), caching-systemen (Redis) en relationele en niet-relationele databases (Postgres, Oracle, MongoDB, Cassandra, S3, …).

- Ervaring met automatiserings- en equipmentprotocollen (bv. MODBUS, OPC UA, S7, …).

- Kennis van DevOps (Jenkins, OpenShift), Docker-containers en versiebeheer (Git, GitLab).

- Goed begrip van softwarearchitectuur en basiskennis van netwerktopologieën.

- Sterke communicatievaardigheden, zowel mondeling als schriftelijk; vloeiend in het Nederlands en het Engels.

- Analytische en pragmatische mindset; vlot in cross-functionele samenwerking.

- Ervaring in een productieomgeving is vereist; ervaring in de farmaceutische of een andere sterk gereguleerde sector is een pluspunt.

- Kennis van Python of JavaScript.

Benefits & conditions

- Een uitdagende rol in een high-tech, internationale productieomgeving met de nieuwste technologieën.

- Een ondernemende en innovatieve cultuur waar out-of-the-box denken en teamwork centraal staan.

- Een zinvolle job met impact op wereldwijde gezondheidszorg en het leven van miljoenen mensen.

- Aanzienlijke investeringen in verdere groei, automatisering en digitalisering.

- Uitgebreide mogelijkheden voor persoonlijke ontwikkeling en een doorgedacht onboardingprogramma.

- Flexibiliteit: 2 dagen per week thuiswerk.

About the company

Onze klant is een van de meest geavanceerde en grootschalige productiesites in zijn sector, actief in een sterk gereguleerde, internationale omgeving. De site maakt gebruik van de nieuwste technologieën: industriële robots, AGV's, geautomatiseerde hoge-snelheidsproductielijnen en artificiële intelligentie. Innovatie en digitalisering zijn de drijvende krachten achter hun strategie voor de komende jaren.

Voor hun digitaliseringsteam zijn wij op zoek naar een gedreven Data Engineer met hands-on ervaring in IT/OT-integratie, Unified Namespace (UNS) en het bouwen van robuuste, realtime datapipelines.

De uitdaging

Het project richt zich op de redesign van de IT/OT-architectuur om het uitrollen van (AI-)applicaties over machines en afdelingen drastisch te vereenvoudigen. De doelarchitectuur moet zowel realtime besluitvorming (AI/ML-modellen) als historische data-analyse ondersteunen.

De drie centrale bouwblokken van het project:

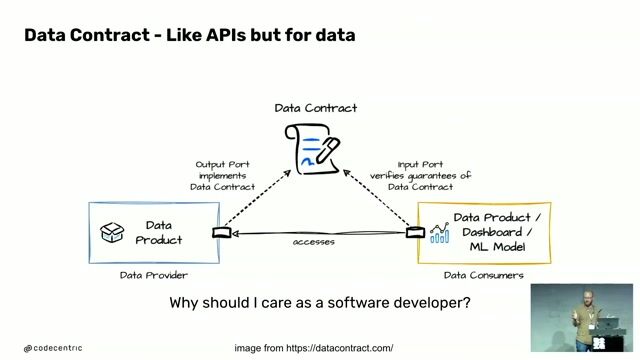

* Een Unified Namespace (UNS) als gestructureerde, hiërarchische laag voor industriële data (ISA-88/95).

* Componenten bouwen of aankopen om equipment-, proces- en productinformatie te extraheren, te verrijken en te publiceren via een message broker.

* Een datarepository inrichten voor het persisteren en structureren van historische metingen en events.