Consultant·e GenAI / LangChain

Umanly

Paris, France

7 days ago

Role details

Contract type

Permanent contract Employment type

Full-time (> 32 hours) Working hours

Regular working hours Languages

French Compensation

€ 55KJob location

Remote

Paris, France

Tech stack

API

Software Quality

Python

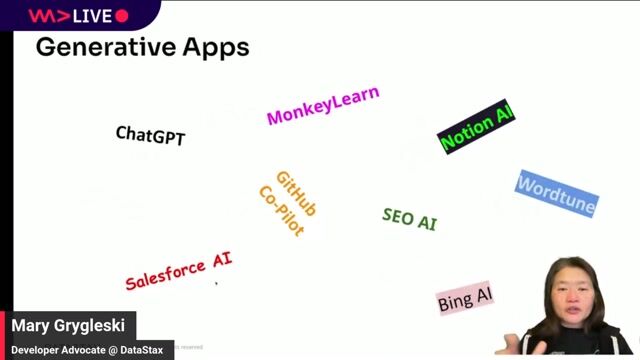

Large Language Models

Generative AI

Backend

FastAPI

Job description

Le contexte demande d'être rapidement opérationnel et à l'aise dans un environnement exigeant.

Vos missions

- Développer des briques applicatives autour de LLM

- Mettre en place des pipelines avec LangChain

- Concevoir des architectures RAG

- Intégrer les modèles dans des workflows existants (outils ITSM)

- Développer des APIs backend en Python (FastAPI)

- Participer aux choix d'architecture et à l'industrialisation

- Contribuer à la qualité du code (tests, documentation, performance)

Stack technique

- Python

- LangChain

- FastAPI

- LLM / RAG / agents

- APIs et intégration systèmes

Requirements

- Formation ingénieur ou équivalent

- Solide expérience en développement backend Python

- Expérience concrète sur des sujets GenAI (LLM, LangChain, RAG ou équivalent)

- Bonne compréhension des architectures de systèmes IA

- Capacité à être rapidement autonome

- À l'aise dans un environnement exigeant, avec peu de cadre

Benefits & conditions

Pourquoi rejoindre Hexamind

- Des projets IA en production, avec de vrais enjeux métier

- Une équipe technique expérimentée

- Un environnement orienté delivery et qualité logicielle

- Une montée en compétence rapide sur les sujets GenAI actuels

- Un niveau d'autonomie élevé dans les choix techniques, Rémunération : 50 000,00€ à 55 000,00€ par an

Avantages :

- Prise en charge du transport quotidien

- RTT

- Travail à domicile occasionnel

Lieu du poste : En présentiel

About the company

Vous rejoignez une équipe d'une dizaine d'ingénieurs sur un projet de helpdesk intelligent pour un groupe international de très grande envergure.

L'objectif est d'automatiser le traitement multimodal des demandes internes en s'appuyant sur des systèmes à base de LLM (RAG, agents, orchestration).

Le projet est ambitieux, déjà en cours depuis plus d'un an et en production, avec des enjeux concrets de mise en production et une forte exposition côté client.