Data Engineer Snowflake F/H

Role details

Job location

Tech stack

Job description

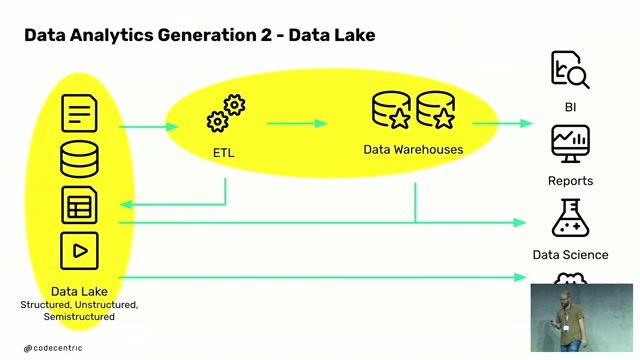

Big Data, Data Science, Data analyse, Data architecture,IA ... Ça n'a pas de secret pour vous? Que vous commenciez votre carrière professionnelle ou que vous soyez spécialiste de l'une de ces disciplines, intégrer notre communauté Data, c'est l'assurance de progresser, innover, partager, vous certifier et rendre service à nos clients. Rejoignez notre centre d'excellence en innovation à Paris et rendez unique l'expérience digitale de nos clients en travaillant sur des sujets tels que le marketing digital, User eXperience, RPA, data, développement web et mobile, API management ou encore cybersécurité. Fonctions et responsabilités En tant que Data Engineer Snowflake, vous accompagnerez nos clients dans leur transformation data et cloud, en participant à la conception et au déploiement de plateformes analytiques de nouvelle génération sur Snowflake. Votre mission consistera à : -comprendre les enjeux métier et identifier les besoins en transformation de données -modéliser et optimiser les architectures data (Data Warehouse, Data Lakehouse) -développer et industrialiser des pipelines de données ELT performants sur Snowflake -mettre en œuvre des stratégies d'optimisation du stockage, de la réplication et des performances -déployer et superviser des solutions en production en adoptant une approche DevOps -contribuer à la montée en compétences de l'équipe et à la communauté Data interne. En rejoignant CGI, vous bénéficiez notamment d'une offre complète de formations (techniques, métiers, développement personnel,…), de flexibilité grâce à notre accord télétravail (jusqu'à 3 jours de télétravail par semaine), d'une politique de congés avantageuse (27 jours de congés payés, RTT, congés ancienneté et enfant malade,…) et d'un package d'avantages intéressant (régime d'achats d'actions, participation, CSE,...).

Requirements

Profil Bac +5 en informatique / data avec au moins 2 ans d'expérience sur des projets Data Engineering en environnement cloud. Compétences techniques essentielles : -expertise sur Snowflake (optimisation des requêtes, SnowSQL, Snowpipe) -maîtrise d'une ou plusieurs pipelines de données ELT et des outils associés serait un plus (DBT, Fivetran, Matillion, etc.) -maîtrise d'un ou plusieurs outils d'intégration de données serait un plus (Talend, Informatica cloud, Tibco, etc.) -solide expérience SQL et Python pour le développement et l'optimisation des traitements -connaissance des services Cloud (AWS, Azure, GCP) et intégration avec Snowflake -expérience en CI/CD et DevOps (GitLab, Jenkins, Terraform). Serait un plus : -Certifications Snowflake (SnowPro Core, Advanced) -Expérience avec Spark / Scala pour des traitements distribués -Notions avancées en gouvernance et sécurité des données (RBAC, Data Sharing, Masking).