Data Engineer GCP - H/F

Role details

Job location

Tech stack

Job description

Au sein d'une équipe produit pluridisciplinaire, le Data Engineer interviendra sur l'ensemble du cycle de vie de la donnée :

Conception et développement de pipelines data

Concevoir, développer et maintenir des pipelines de données (ETL/ELT)

Collecter et transformer des données issues de multiples sources (bases de données, fichiers, APIs)

Orchestrer les flux de données dans un environnement cloud

Optimiser les performances et la consommation des ressources

Modélisation et gestion des données

Concevoir et faire évoluer les modèles de données

Garantir la qualité, la cohérence et l'intégrité des données

Mettre en place des stratégies de gestion du cycle de vie des données

Run opérationnel et support

Assurer le support de niveau avancé (N2/N3)

Diagnostiquer et résoudre les incidents liés aux flux de données

Rédiger et maintenir des scripts d'automatisation (Bash)

Écrire et optimiser des requêtes SQL complexes

Monitoring et amélioration continue

Mettre en place des outils de supervision des pipelines et des données

Définir des alertes pour anticiper les anomalies

Construire des tableaux de bord de suivi des performances

Infrastructure et industrialisation

Participer à la mise en place d'infrastructures via des outils d'Infrastructure as Code

Garantir la reproductibilité des environnements (dev, test, production)

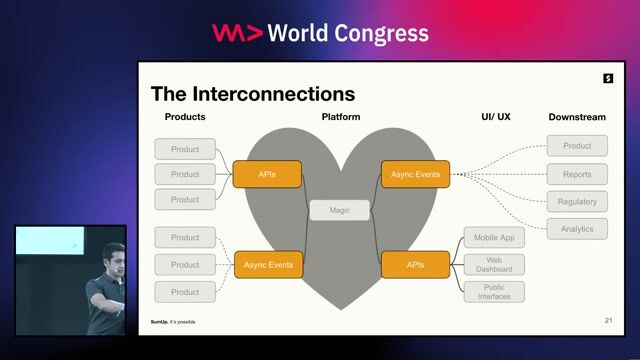

Collaboration transverse

Travailler en étroite collaboration avec les équipes data, produit et métier

Accompagner les utilisateurs sur les bonnes pratiques data

Participer aux rituels Agile

Stack technique

Cloud & Data

- Google Cloud Platform (BigQuery, Dataflow, Dataproc, Cloud Storage, Pub/Sub)

- Outils d'orchestration (Airflow / Cloud Composer)

Bases de données

- BigQuery

- Oracle

- (Connaissance de PostgreSQL / MySQL appréciée)

Langages & scripting

- SQL avancé

- Bash

Infrastructure & DevOps

- Terraform (Infrastructure as Code)

- Git / GitLab CI (CI/CD)

Monitoring & visualisation

- Outils de monitoring cloud

- Grafana / ELK Stack

- Outils de dataviz (type Looker Studio)

Environnement

- Linux (RedHat)

Requirements

Expérience confirmée en Data Engineering (minimum 3 ans)

Maîtrise des architectures data (Data Lake, Data Warehouse, ETL/ELT)

Expertise sur un environnement cloud (idéalement GCP)

Excellente maîtrise de SQL et bonne capacité d'analyse de données

Compétences solides en scripting Bash

Forte capacité d'analyse et de résolution de problèmes

Autonomie et proactivité

Rigueur dans la gestion des données en production

Bon relationnel et capacité à collaborer avec des équipes variées

Sens des responsabilités sur des systèmes critiques

Expérience en environnement Agile (Scrum ou Kanban) You must create an Indeed account before continuing to the company website to apply

Benefits & conditions

Taux journalier (TJM): 350 - 400, * Mission longue durée

- Organisation hybride (présentiel / télétravail)

- Intégration dans une équipe produit data