Senior Data & AI Engineer Sovereign Cloud

Role details

Job location

Tech stack

Job description

Gemeinsam mit einem dynamischen, leidenschaftlichen Team hast du die Chance, an wegweisenden Projekten und spannenden Herausforderungen im öffentlichen Sektor und weiteren Branchen mitzuwirken. Deine Arbeit reicht von der ersten Datenaufnahme über anspruchsvolle Transformationen und Qualitätssicherung bis hin zur Bereitstellung für modernste Analytics-, Reporting- und (Gen)AI-Use-Cases. Dabei bist du Pionier:in, wenn es darum geht, innovative AI-Lösungen in die Datenwelt zu integrieren und so den technologischen Wandel aktiv voranzutreiben.

- Du begleitest alle relevanten Phasen einer Datenlösung - von der Anforderungsaufnahme über Integration und Betrieb bis hin zu Monitoring und kontinuierlicher Optimierung. Dabei stellst du robuste, transparente Datenflüsse in regulierten Umgebungen sicher.

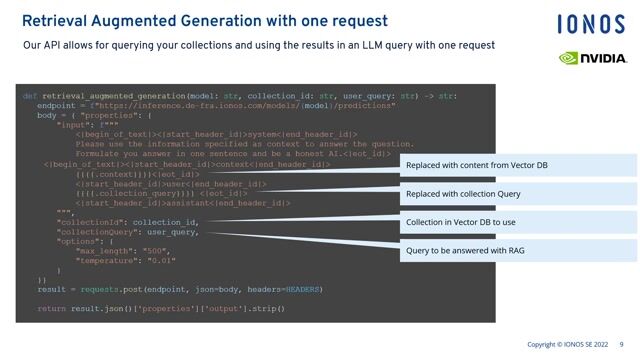

- Du setzt KI- und GenAI-Tools verantwortungsvoll ein, z. B. zur Unterstützung bei Code-Erstellung, Dokumentation, Tests und Qualitätssicherung. Gemeinsam mit Kund*innen und Projektteams entwickelst du sichere Integrationsmuster und wirkst an deren Umsetzung in agentenbasierten Lösungen mit.

- Du konzipierst und entwickelst skalierbare Architektur- und Plattformlösungen für On-Premise-, Hybrid- oder Sovereign-Cloud-Umgebungen. Dabei berücksichtigst du Anforderungen an Daten- und Plattform-Souveränität und nutzt Open-Source-Technologien (z. B. aus dem Apache-Ökosystem, Kubernetes oder distributionsbasierte Plattformen), optional ergänzt durch kommerzielle Komponenten wie IBM watsonx. Du setzt moderne Lakehouse-Konzepte sowie Batch- und Streaming-Verarbeitung ein.

- Du modellierst Daten effizient (z. B. Star-Schema, Normalformen oder Data Vault) und entwickelst skalierbare Datenpipelines mit Python, SQL sowie gängigen ETL-/ELT-Frameworks und Tools wie Airflow oder dbt. Ziel ist die Bereitstellung qualitativ hochwertiger Datenprodukte für Analytics, Reporting und KI-Anwendungen.

- Du integrierst Security-by-Design-Prinzipien, berücksichtigst geltende Compliance- und Governance-Anforderungen und arbeitest mit etablierten Entwicklungsstandards (z. B. Git, CI/CD, testbare Komponenten). Themen wie Datenqualität, Observability, Kosten-, Performance- und Sicherheitsaspekte fließen dabei kontinuierlich in deine Arbeit ein.

- Du moderierst Workshops, analysierst fachliche und technische Anforderungen und überführst diese in strukturierte Backlogs. Du entwickelst Demos, präsentierst Ergebnisse und lieferst technischen Input für Angebote. Darüber hinaus unterstützt du den Wissenstransfer im Team und in der Community, z. B. durch Coaching oder fachlichen Austausch., * Flexible Arbeitszeit- und Auszeitmodelle

- Mobiles Arbeiten - auch hybrid von Zuhause aus

- Jobfahrrad-Programm

- Mobilitätsbudget

- Vielfältiges Weiterbildungsangebot

- Internationales Netzwerk

- Kooperation mit dem pme Familienservice

- Deferred Compensation - im Alter gut abgesichert

- Verlängerte Entgeltfortzahlung im Krankheitsfall

- Gesundheitsangebote

- Attraktiver Arbeitsplatz für Menschen mit Handicap

- Kontakthalteprogramm fareWelcome!

- Work-life-balance

- Mitarbeiterrabatte

- Team- und Sportevents

Requirements

- Du verfügst über umfangreiche praktische Erfahrung im Aufbau, Betrieb und in der Weiterentwicklung produktionsreifer Datenplattformen und -pipelines, idealerweise im öffentlichen Sektor oder in hochregulierten, souveränen Umgebungen.

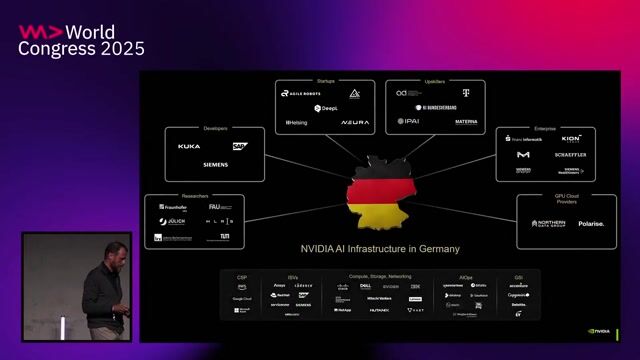

- Du besitzt fundierte Kenntnisse im Open-Source-Daten- und Plattform-Ökosystem (z. B. Apache Stack, Cloudera) sowie optional in IBM watsonx. Zudem hast du Erfahrung mit On-Prem-Architekturen, hybriden Plattformen oder souveränen Cloud-Modellen.

- Du verfügst über sehr gute Kenntnisse in SQL, Python, Datenmodellierung sowie ETL/ELT-Prozessen. Orchestrierungswerkzeuge wie Airflow, Automatisierungstools wie dbt sowie Git, CI/CD, Testautomatisierung und gängige Governance- und Security-Standards setzt du sicher ein.

- Du nutzt KI-gestützte Werkzeuge wie Copilot oder Claude im Engineering-Kontext und verstehst agentische Muster sowie deren sichere und souveräne Integration in Datenplattformen.

- Du bist in der Lage, Anforderungen strukturiert aufzunehmen, Workshops zu moderieren und komplexe technische sowie fachliche Zusammenhänge verständlich darzustellen. Du kannst Trade-offs transparent erklären und adressatengerecht einordnen.

- Du verfügst über ein abgeschlossenes Studium der (Wirtschafts-)Informatik, eines MINT-Fachs oder über eine vergleichbare Qualifikation durch praktische Erfahrung. Sehr gute Deutsch- und Englischkenntnisse sowie projektbezogene Reisebereitschaft runden dein Profil ab.