Data Engineer

Role details

Job location

Tech stack

Job description

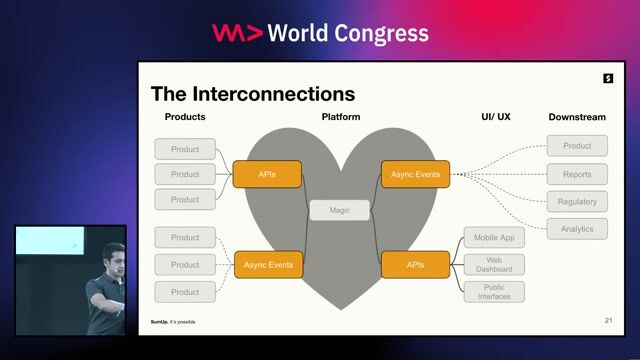

Au sein de la Data Platform, vous contribuerez à la conception et au développement de services digitaux centrés sur la donnée, en collaboration avec les équipes métiers et techniques., Concevoir, développer et maintenir des solutions de traitement de données à grande échelle (BigQuery, BigTable, Apache Kafka, Apache Spark).

- Participer activement à la montée en compétence sur l'ETL BigL et à la réalisation de projets métier via la solution ELT in-House Big Loader et BDI/DBT.

- Garantir la qualité et la performance des solutions mises en place, en étroite collaboration avec les équipes de développement et de production.

- Accompagner techniquement les membres juniors de l'équipe.

- Contribuer aux choix d'architecture technique et livrer des composants robustes.

Requirements

Profil recherché :Nous recherchons un(e) Data Engineer diplômé(e) d'une école d'ingénieur (Bac +5) avec 3 à 7 ans d'expérience en Java et/ou Scala, maîtrisant la programmation fonctionnelle et le SQL avancé (notamment BigQuery pour le traitement de gros volumes de données).Compétences techniques requises :Streaming et traitement distribué : Apache Kafka et Apache Spark.Cloud et orchestration : GCP (Google Cloud Platform), Pub/Sub, et DBT pour la gestion des pipelines.CI/CD et environnement : GitLab CI/CD, Docker Compose, Linux, et Git.Méthodologies et soft skills :Expérience en Agile/Scrum et capacité à collaborer dans des équipes pluridisciplinaires.Autonomie, esprit d'équipe, et rigueur pour respecter les délais et les standards de qualité.Excellente communication en français (oral et écrit) pour interagir avec les équipes métiers., Nous recherchons un(e) Data Engineer diplômé(e) d'une école d'ingénieur (Bac +5) avec 3 à 7 ans d'expérience en Java et/ou Scala, maîtrisant la programmation fonctionnelle et le SQL avancé (notamment BigQuery pour le traitement de gros volumes de données).

Compétences techniques requises :

- Streaming et traitement distribué : Apache Kafka et Apache Spark.

- Cloud et orchestration : GCP (Google Cloud Platform), Pub/Sub, et DBT pour la gestion des pipelines.

- CI/CD et environnement : GitLab CI/CD, Docker Compose, Linux, et Git.

Méthodologies et soft skills :

- Expérience en Agile/Scrum et capacité à collaborer dans des équipes pluridisciplinaires.

- Autonomie, esprit d'équipe, et rigueur pour respecter les délais et les standards de qualité.

- Excellente communication en français (oral et écrit) pour interagir avec les équipes métiers.