Data Engineer / Analytics Engineer - Snowflake & dbt

Role details

Job location

Tech stack

Job description

Concevoir, développer et maintenir des pipelines de données ELT performants avec Snowflake et dbt

- Modéliser les données (conceptuel et technique) selon les besoins métier

- Optimiser les requêtes SQL et les modèles dbt pour garantir les performances

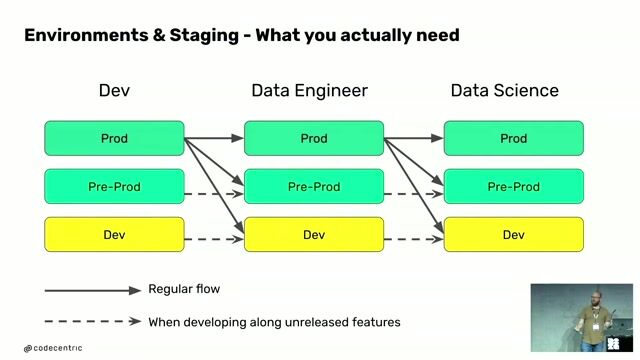

- Mettre en place et maintenir une infrastructure DataOps (CI/CD, automatisation)

- Gérer la sécurité des données : RBAC, Row-Level Security, Dynamic Data Masking

- Assurer l'ingestion des données depuis AWS S3 vers Snowflake

- Orchestrer les flux de données (dbt, DAGs, gestion des dépendances et tags)

- Implémenter des tests de qualité des données via dbt

- Administrer les environnements Snowflake (gestion des objets, supervision, optimisation), Snowflake

- Maîtrise avancée (Time Travel, Zero-Copy Cloning)

- Optimisation et configuration des warehouses

- Gestion des external stages et Snowpipe

- Mise en oeuvre des mécanismes de sécurité (RBAC, RLS, masking)

- Administration complète de la plateforme

dbt (data build tool)

- Développement avancé de modèles SQL

- Modélisation analytique (tables de faits, dimensions)

- Utilisation des macros Jinja

- Tests de qualité des données

- Snapshots pour le suivi des données

- Création de DAGs optimisés (dépendances, tags)

- Documentation des modèles

DataOps & Automatisation

- Automatisation des migrations avec schemachange

- Mise en place de pipelines CI/CD

- Maîtrise de Git et des workflows collaboratifs

Requirements

Compétences techniques requisesSnowflakeMaîtrise avancée (Time Travel, Zero-Copy Cloning)Optimisation et configuration des warehousesGestion des external stages et SnowpipeMise en oeuvre des mécanismes de sécurité (RBAC, RLS, masking)Administration complète de la plateformedbt (data build tool)Développement avancé de modèles SQLModélisation analytique (tables de faits, dimensions)Utilisation des macros JinjaTests de qualité des donnéesSnapshots pour le suivi des donnéesCréation de DAGs optimisés (dépendances, tags)Documentation des modèlesDataOps & AutomatisationAutomatisation des migrations avec schemachangeMise en place de pipelines CI/CDMaîtrise de Git et des workflows collaboratifsAWS & IntégrationBonne connaissance de AWS S3Intégration et ingestion vers Snowflake Qualifications souhaitéesExpérience avec Snowflake Tasks et Dynamic TablesConnaissance des concepts de data mesh et de gouvernanceExpérience avec des frameworks de tests de donnéesExpérience dans le secteur pharmaceutique / life sciences Certifications appréciéesSnowPro Core Certification (fortement recommandée)Certification dbt Analytics EngineeringCertifications AWS (Solutions Architect, Data Engineer...), AWS & Intégration

- Bonne connaissance de AWS S3

- Intégration et ingestion vers Snowflake

Qualifications souhaitées

- Expérience avec Snowflake Tasks et Dynamic Tables

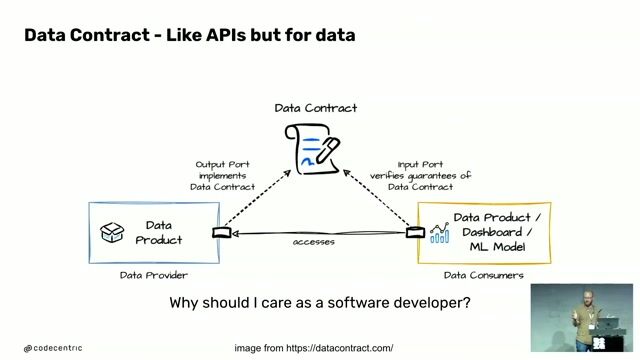

- Connaissance des concepts de data mesh et de gouvernance

- Expérience avec des frameworks de tests de données

- Expérience dans le secteur pharmaceutique / life sciences

Certifications appréciées

- SnowPro Core Certification (fortement recommandée)

- Certification dbt Analytics Engineering

- Certifications AWS (Solutions Architect, Data Engineer...)