Data Engineer Specialist + Fabric

Role details

Job location

Tech stack

Job description

-

Diseñar e implementar arquitecturas modernas de datos basadas en Microsoft Fabric, siguiendo principios de Lakehouse y arquitecturas Medallion (Bronze, Silver, Gold).

-

Participar en proyectos de modernización de plataformas de datos, incluyendo migraciones desde bases de datos tradicionales (Oracle, SQL Server u otros sistemas relacionales) hacia entornos basados en Fabric o plataformas cloud.

-

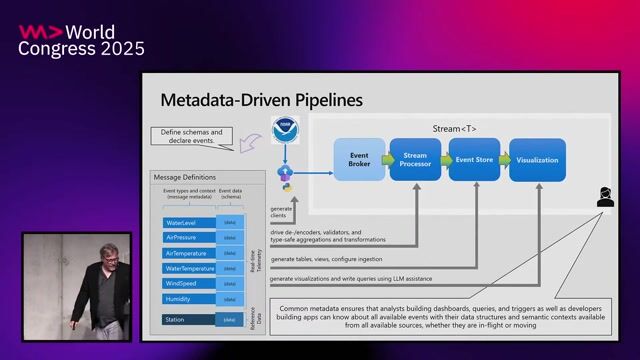

Diseñar e implementar pipelines de ingesta y transformación de datos utilizando herramientas de Microsoft Fabric como:

-

Data Factory / Pipelines

-

Dataflows Gen2

-

Lakehouse

-

Notebooks (Spark)

-

Construir procesos de ETL/ELT escalables utilizando PySpark, Spark SQL y Delta Lake.

-

Modelar datos para consumo analítico mediante modelos dimensionales y datasets optimizados para Power BI.

-

Diseñar procesos de automatización, orquestación y control de calidad de datos, asegurando trazabilidad y gobernanza.

-

Participar en la definición de modelos semánticos y datasets gobernados para analítica empresarial.

-

Colaborar con equipos de analítica, negocio y BI para transformar requerimientos en soluciones técnicas escalables.

-

Identificar oportunidades de mejora en arquitecturas existentes y proponer estrategias de optimización, modernización o migración a Fabric.

Requirements

Buscamos un/a Ingeniero/a de Datos especializado/a en plataformas modernas de datos para formar parte de nuestro equipo de analítica avanzada. El rol estará enfocado en el diseño, construcción y evolución de plataformas de datos basadas en Microsoft Fabric, así como en procesos de modernización y migración desde entornos tradicionales (Oracle, sistemas on-premise o arquitecturas legacy) hacia arquitecturas modernas basadas en Lakehouse.

La persona seleccionada participará activamente en la construcción de arquitecturas de datos escalables, gobernadas y orientadas a analítica, trabajando con tecnologías como Microsoft Fabric, Databricks, PySpark y Power BI.

Buscamos un perfil técnico con mentalidad de ingeniería, experiencia en procesamiento de datos a escala y capacidad para participar en proyectos de transformación hacia arquitecturas modernas de datos.

La persona ideal deberá contar con al menos 3 años de experiencia en ingeniería de datos, de los cuales al menos 1 año debe estar relacionado con Microsoft Fabric o con procesos de migración hacia arquitecturas Lakehouse/Fabric.

FORMACIÓN:

- Titulación en:

Ingeniería Informática Matemáticas Estadística Ingeniería de Sistemas o carreras afines.

Se valorará máster en:

Big Data Ingeniería de Datos Ciencia de Datos Business Intelligence.

CAPACIDADES TÉCNICAS: * Experiencia sólida en ingeniería de datos y procesamiento de datos a escala

- Experiencia trabajando con Microsoft Fabric, incluyendo: Lakehouse, Pipelines, Dataflows Gen2, Notebooks Spark e integración con Power BI

- Experiencia en arquitecturas Lakehouse y modelos Medallion.

- Experiencia en procesos de migración o modernización de plataformas de datos, por ejemplo: migración desde Oracle / SQL Server, migración desde Data Warehouse tradicionales, migración desde plataformas cloud (AWS, GCP, Snowflake, etc.) hacia Fabric.

- Dominio de SQL avanzado, optimización de consultas y modelado de datos.

- Experiencia en Databricks y procesamiento distribuido con PySpark / Spark SQL.

- Experiencia diseñando pipelines de datos y procesos de ingesta automatizados.

- Conocimiento de modelado dimensional para analítica.

- Experiencia integrando plataformas de datos con Power BI o herramientas de BI similares.

- Valorable experiencia en Python o Scala para transformaciones avanzadas.

- Conocimiento de gobernanza de datos, linaje y calidad de datos., Alta capacidad de resolución de problemas técnicos complejos.

- Mentalidad analítica y enfoque estructurado.

- Capacidad para trabajar de forma autónoma en entornos técnicos exigentes.

- Buenas habilidades de comunicación para colaborar con equipos técnicos y de negocio.

- Interés por arquitecturas modernas de datos y evolución hacia plataformas cloud.