Data Engineer H/F

Role details

Job location

Tech stack

Job description

- Support aux incidents en phase d'industrialisation et en phase de production.

- Intégration de nouvelles solutions dans l'environnement existant.

- Maintenance corrective et évolutive des systèmes en place.

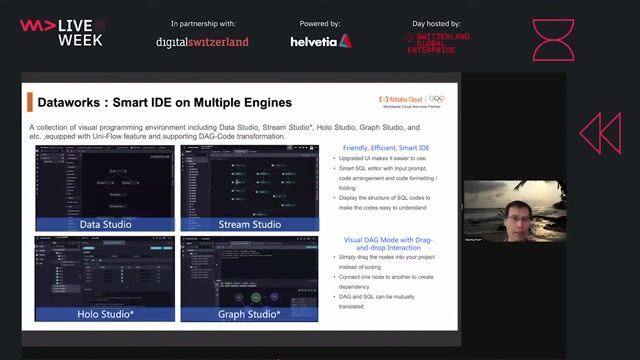

- Conception et développement de pipelines de données robustes et scalables.

- Mise en place et optimisation des vues et des intégrations avec Denodo.

- Collaboration étroite avec les équipes Data Science et BI pour optimiser les flux de données.

- Garantie de la qualité, sécurité et conformité des données traitées.Votre profil

Requirements

· Diplôme d'Ingénieur(e) ou diplôme équivalent de niveau Bac +5 en informatique ou en sciences des données. · Une bonne maîtrise de l'anglais est requise, tant à l'écrit qu'à l'oral. · Vous avez une expertise avérée avec Denodo, Tableau Software, et des outils d'intégration de données. · Vous maîtrisez la programmation SQL et connaissez les principes de l'architecture des données ainsi que les bonnes pratiques en matière de gestion des données.3 raisons de nous rejoindre : Qualité de vie au travail : accord de télétravail en France et à l'international, accord sur l'égalité professionnelle, la parentalité, l'équilibre des temps et la mobilité durable., · Diplôme d'Ingénieur(e) ou diplôme équivalent de niveau Bac +5 en informatique ou en sciences des données. · Une bonne maîtrise de l'anglais est requise, tant à l'écrit qu'à l'oral. · Vous avez une expertise avérée avec Databricks, PySpark et PowerBI, et avez une experience dans la conception et l'implémentation de data lakes et data warehouse · Vous maîtrisez la programmation Python et SQL, et connaissez des principes de l'architecture des données et des bonnes pratiques en matière de gestion des données · Vous êtes familiers avec les environnements cloud (Azure, AWS ou GCP) ., · Diplôme d'Ingénieur(e) ou diplôme équivalent de niveau Bac +5 en informatique ou en sciences des données. · Une bonne maîtrise de l'anglais est requise, tant à l'écrit qu'à l'oral. · Vous avez une expertise avérée avec Databricks, PySpark et PowerBI, et avez une experience dans la conception et l'implémentation de data lakes et data warehouse · Vous maîtrisez la programmation Python et SQL, et connaissez des principes de l'architecture des données et des bonnes pratiques en matière de gestion des données · Vous êtes familiers avec les environnements cloud (Azure, AWS ou GCP)

About the company

Capgemini ist einer der weltweit führenden Anbieter von Management- und IT-Beratung, Technologie-Services und Digitaler Transformation. Als ein Wegbereiter für Innovation unterstützt das Unternehmen seine Kunden bei deren komplexen Herausforderungen rund um Cloud, Digital und Plattformen.