Data Engineer - Architecture de streaming data

Role details

Job location

Tech stack

Job description

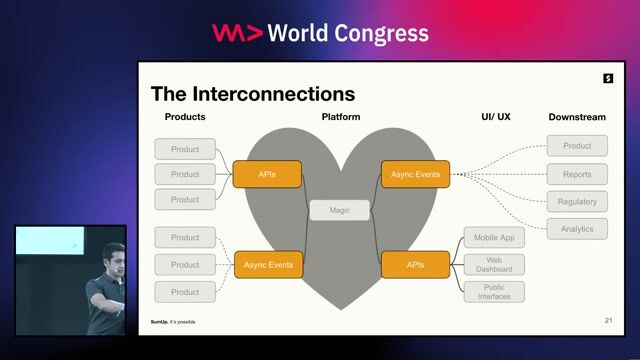

Tu seras au coeur du plan de transformation DATA de notre compte client, qui vise à autonomiser les métiers business (pilotage, marketing, commerce, etc.) dans l'analyse des données et des KPI grâce à des applications DATA avancées., En tant que Data Engineer sur des architectures de streaming data, tu seras en charge de :

- Concevoir et développer des pipelines de données performants.

- Développer des solutions en utilisant des outils comme Scala, Spark, DBT.

- Implémenter des architectures de Streaming Data sur AWS (Lambda, Kinesis Stream, S3, Firehose, EMR Serverless, DynamoDB, etc.).

- Contribuer aux initiatives FinOps pour optimiser les coûts liés aux architectures Big Data.

- Développer et optimiser des traitements d'intégration de données en streaming, traitant plus de 100 To de données par jour.

- Participer à des projets innovants tels que :

- Systèmes de recommandation AI ;

- Feature Store ;

- Modernisation des flux financiers ;

- Plateforme de traitement des données CRM et usage ;

- Intégration de données pour partenaires stratégiques.

Requirements

Tu as au moins 5ans d'expérience dans des environnements similaires.Tu possèdes une excellente connaissance des architectures de Streaming Data et des environnements Big Data.Tu maîtrises AWS et ses services (Lambda, Kinesis Stream, EMR Serverless, S3, DynamoDB).Tu es maitrisant en Scala et Spark.Tu utilises les outils Snowflake, GitLab CI/CD, Terraform.Tu es autonome, ouvert d'esprit, et doté d'une grande curiosité.Tu esà l'aise dans un environnement international.Tu es un excellent communicant et sais évoluer dans des équipes agiles.Les outils comme JIRA et les méthodologies Scrum/Kanban te sont familiers., Tu as au moins 5ans d'expérience dans des environnements similaires.

Tu possèdes une excellente connaissance des architectures de Streaming Data et des environnements Big Data.

Tu maîtrises AWS et ses services (Lambda, Kinesis Stream, EMR Serverless, S3, DynamoDB).

Tu es maitrisant en Scala et Spark.

Tu utilises les outils Snowflake, GitLab CI/CD, Terraform.

Tu es autonome, ouvert d'esprit, et doté d'une grande curiosité.

Tu esà l'aise dans un environnement international.

Tu es un excellent communicant et sais évoluer dans des équipes agiles.

Les outils comme JIRA et les méthodologies Scrum/Kanban te sont familiers.